课程价格 :

¥999.00

剩余名额

0

-

学习时长

8周/建议每周至少8小时

-

答疑服务

专属微信答疑群/讲师助教均参与

-

作业批改

每章节设计作业/助教及时批改评优

-

课程有效期

一年/告别拖延,温故知新

课程价格:

¥999.00

预约下一期 *课程已报满,可预约下一期

![]() 支持花呗分期

支持花呗分期

*课程已报满,可预约下一期

- 1-1:助教分享.pdf

- 1-2:开课仪式

- 第1章: 语音合成综述

- 第1节: 课程介绍

- 2-1:【课件】语音合成第一章课件

- 2-2:【视频】课程介绍

- 第2节: 智能语音处理及应用

- 3:【视频】智能语音处理及应用

- 第3节: 语音合成介绍

- 4:【视频】语音合成介绍

- 第4节: 文本分析

- 5:【视频】文本分析

- 第5节: 语音合成方法

- 6-1:【视频】语音合成方法

- 6-2:【视频】高阶话题

- 第2章: 语音合成中的前端文本分析

- 7:【课件】前端文本分析

- 第1节: 回顾

- 8:【视频】回顾

- 第2节: 文本分析模块

- 9:【视频】文本分析模块

- 第3节: 条件随机场

- 10:【视频】图模型基础

- 11:【视频】条件随机场

- 第4节: 基于传统方法的前端文本分析模型

- 12:【视频】基于传统方法的前端文本分析模型

- 第5节: RNN与LSTM(额外补充)

- 13:【视频】循环神经网络RNN

- 第6节: 基于NN的文本分析

- 14:【视频】基于NN的文本分析

- 第7节: 作业实践

- 15:【视频】作业实践

- 16-1:【作业】第二章

- 16-2:第二章作业的解答

- 第3章: 传统语音合成算法

- 第1节: 传统语音合成概述

- 17-1:【课件】第三章

- 17-2:【视频】传统语音合成概述

- 第2节: 基于HMM的统计参数语音合成

- 18-1:【视频】统计参数语音合成框架

- 18-2:【视频】隐马尔可夫模型(HMM)

- 18-3:【视频】多空间概率分布MD-HMM

- 18-4:【视频】基于HMM的参数语音合成

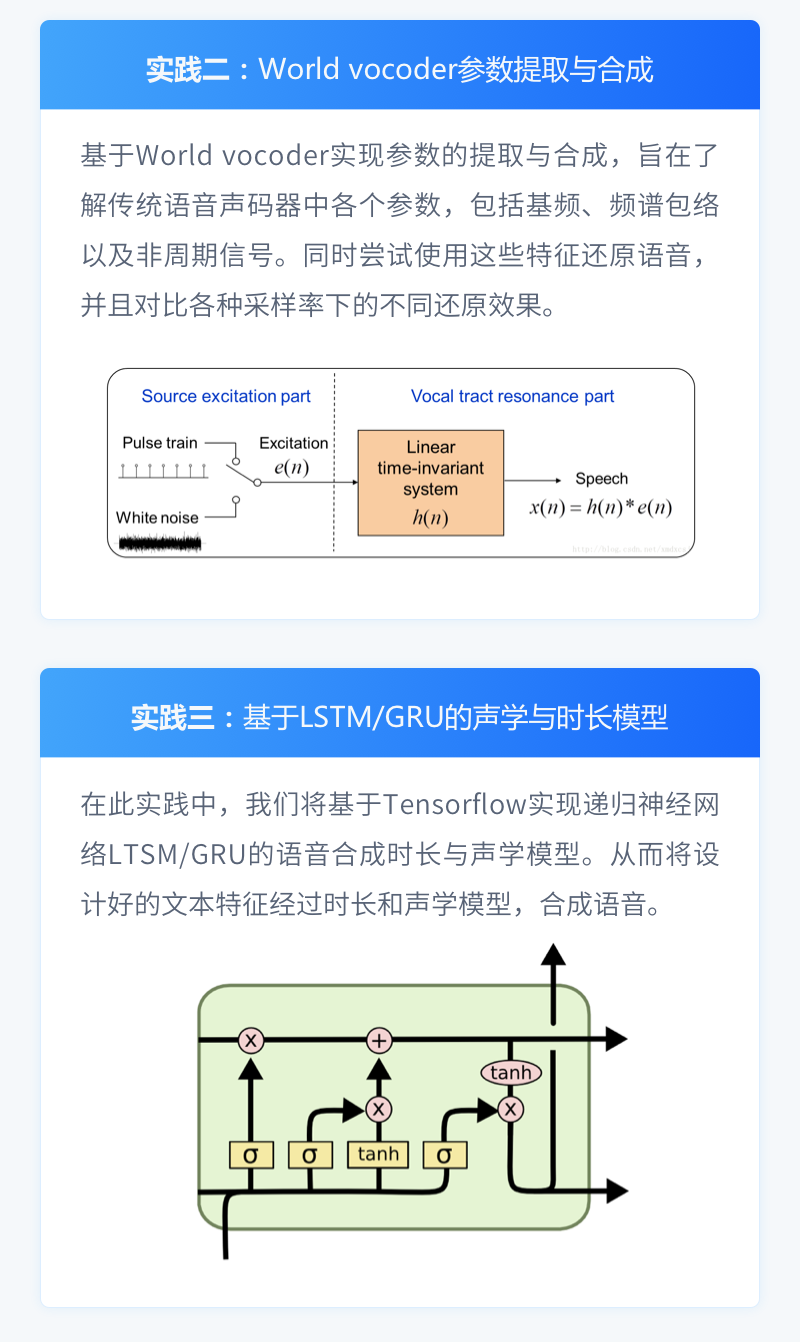

- 第3节: 基于NN的统计参数语音合成

- 19:【视频】基于神经网络(NN)的统计参数语音合成

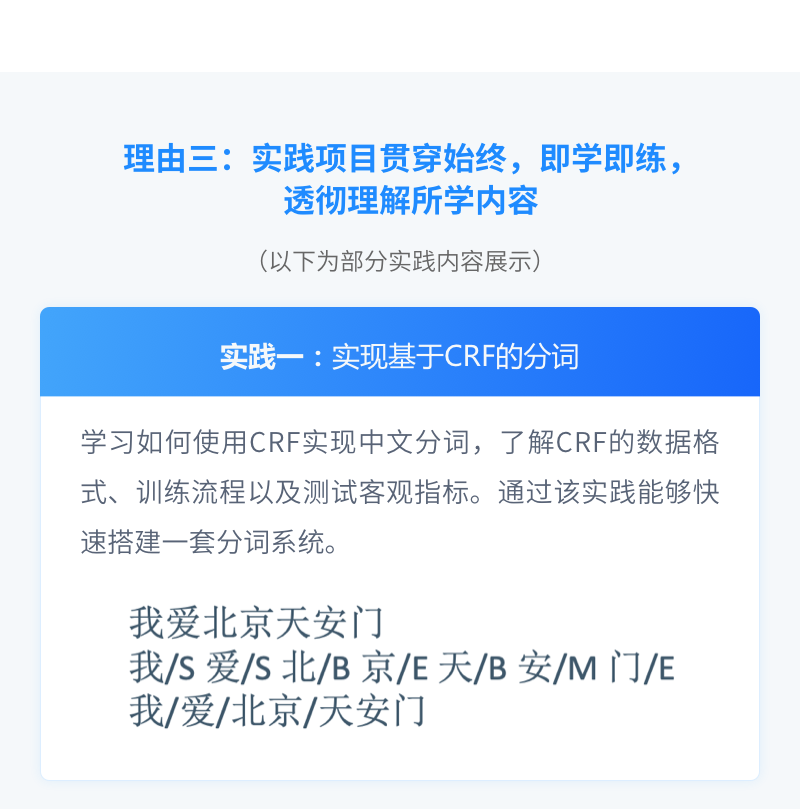

- 第4节: 传统声码器技术

- 20:【视频】传统声码器与单元拼接语音合成

- 第5节: 【实践】作业实践

- 21-1:【作业】第三章

- 21-2:第三次作业SPTK的问题

- 21-3:第三章作业解答.pdf

- 第4章: 基于seq2seq的语音合成

- 第1节: 概述

- 22-1:【课件】语音合成第四章

- 22-2:【视频】概述

- 第2节: Sequence-to-Sequence 和 Attention机制

- 23:【视频】seq2seq与Attention机制

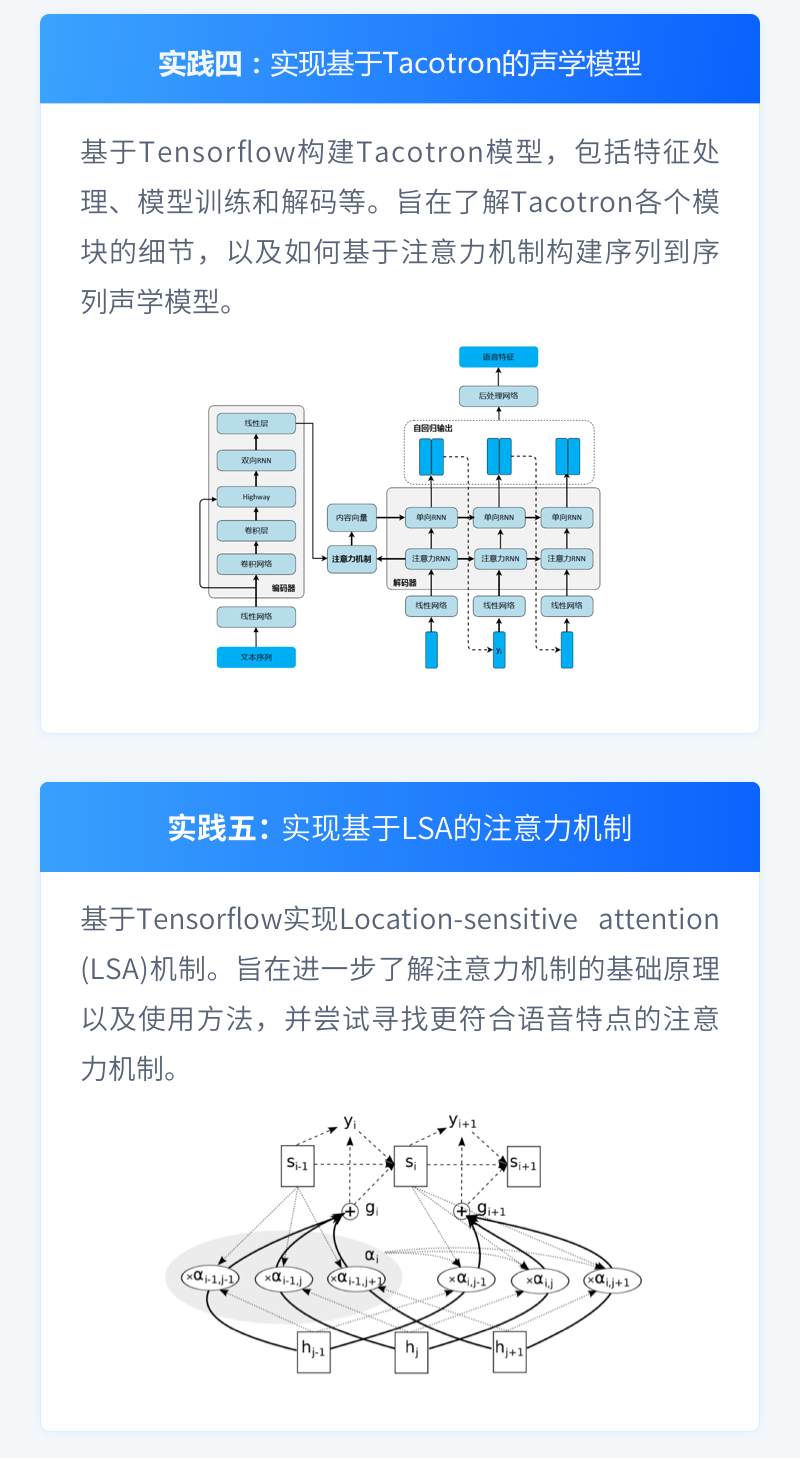

- 第3节: 基于Tacotron的端到端语音合成及变体

- 24:【视频】Tacotron

- 第4节: 端到端语音合成的变体(一)

- 25:【视频】seq2seq声学模型变体

- 第5节: 【实践】实现基于Tacotron的声学模型

- 26-1:【视频】实践作业介绍

- 26-2:【作业】第四章

- 26-3:第四章作业讲解.pdf

- 第5章: 端到端语音合成进阶

- 第1节: 概述

- 27-1:【课件】语音合成 第五章

- 27-2:【视频】概述

- 第2节: Attention与Transformer

- 28-1:【视频】Attention

- 28-2:【视频】Transformer TTS

- 第3节: 序列到序列的模型变体

- 29-1:【视频】Transformer加入自注意力机制

- 29-2:【视频】变体2:Transformer中加入RNN

- 29-3:【视频】变体3:Transformer中直接建模局部依赖

- 第4节: Attention机制探索

- 30:【视频】Attention机制探索

- 第5节: FastSpeech和DurIAN

- 31:【视频】FastSpeech and DurIAN

- 第6节: 【实践】实现基于LSA的attention机制的语音合成

- 32:【作业】第五章

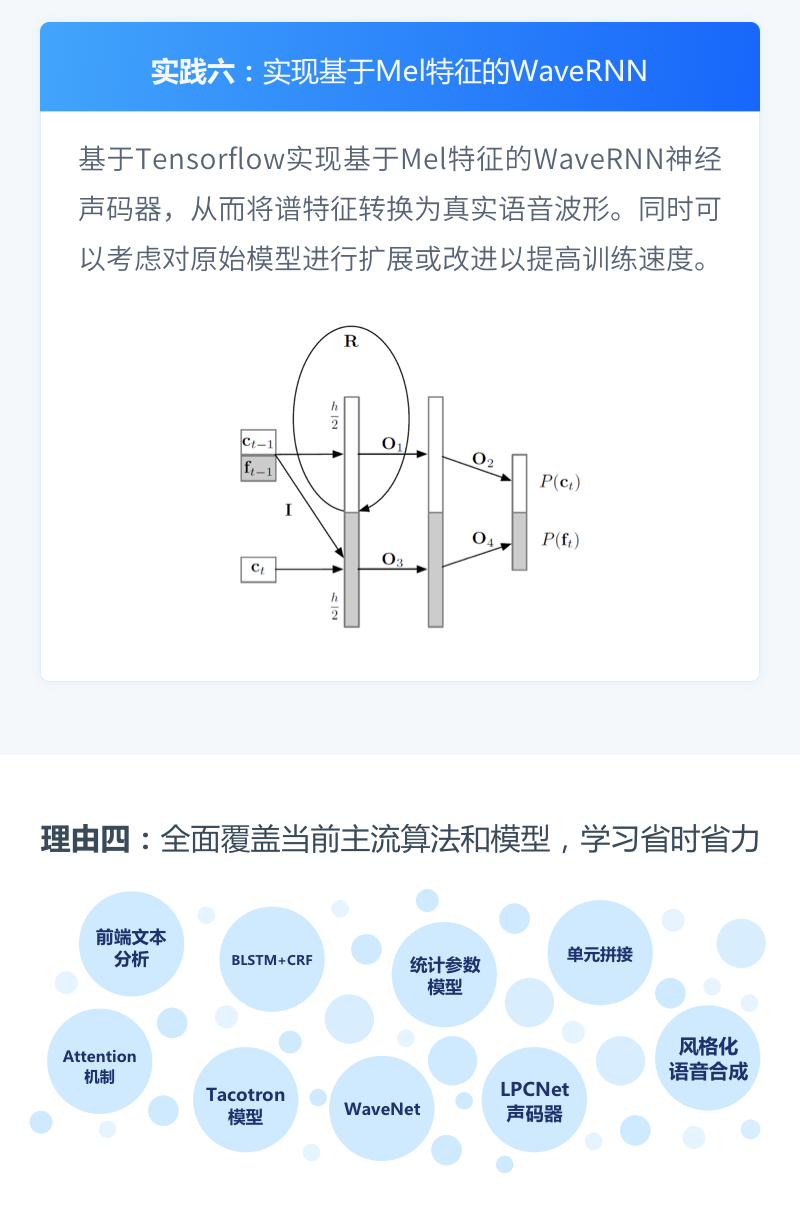

- 第6章: 神经网络声码器

- 第1节: 概述

- 33-1:【课件】L6 神经声码器

- 33-2:【视频】概述

- 第2节: 基于Flow的神经声码器

- 34:【视频】基于Flow的神经声码器

- 第3节: 基于GAN的神经声码器:Parallel WaveGAN, MelGAN

- 35:【视频】基于GAN的神经声码器

- 第4节: 实践作业

- 36:【作业】第六章

- 第7章: 语音合成的高阶应用(选修)

- 第1节: 高阶应用

- 37-1:【课件】语音合成 L7 高阶应用

- 37-2:【视频】高阶应用

- 第2节: 作业(选修)

- 38:【作业】第七章

- 第8章: 总结展望

- 第1节: 课程总结

- 39-1:【课件】L8 总结

- 39-2:【视频】课程总结